Durante décadas, el público ha visto fotos sublimes de estrellas y galaxias distantes producidas por la NASA, con unas pocas imágenes, como los Pilares de la Creación, alcanzando el estatus de íconos. Todo el mundo sabe de dónde provienen esas imágenes: de naves espaciales como el telescopio espacial Hubble o del Mars Rover, pero eso es sólo la mitad de la historia. Lo que es menos conocido es que los datos en bruto tienen un extenso procesamiento antes de ser liberados al mundo.

En una entrada de blog del 28 de septiembre, Adobe expone la edición y post-producción involucrada en la creación de las obras maestras visuales de la NASA. Para crear el paisaje panorámico de Marte, los editores de la NASA tienen primero que unir docenas de fotos, la mayoría de las cuales no están alineadas con el horizonte, y recortar las esquinas para dar un marco geométrico a la fotografía.

El Mars Rover también toma fotos en 3D con dos cámaras simultáneas, lo que se traduce en una serie de imágenes que necesitan ser unidas para que sean visualmente coherentes. Por último, las imágenes se corrigen en su brillo para equilibrar los problemas de iluminación creados por el polvo marciano.

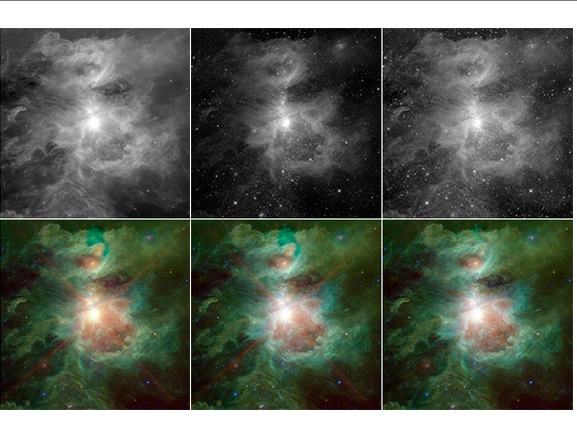

Los ajustes hechos por NASA se esfuerzan en que las fotos sean lo más exactas posible en términos científicos, y los cambios se realizan tanto por la estética como por la riqueza de la información. Cuando la NASA agrega colores a las fotos de cuerpos cósmicos lejanos, la paleta refleja lo que los ojos verían si fueran sensibles al color en un amplio espectro.

«Básicamente tomo los datos en bruto de la escala de grises de diferentes partes del espectro infrarrojo, y luego les reasigno colores visibles –típicamente con capas de Photoshop rojas, verdes y azules– para crear imágenes que son exactamente representativas de los colores infrarrojos que los ojos humanos no pueden ver” según le contó a Adobe Robert Hurt, astrónomo y científico de visualización en el Centro de Procesamiento y Análisis Infrarrojo de Caltech. «Pienso en ello como un proceso de traducción visual».

El trabajo de Hurt no se limita a poner de relieve los detalles en las fotos que no son visibles para el ojo humano, sino también el eliminar artefactos de la cámara que podrían engañar al espectador haciéndolo pensar que hay estrellas o planetas que no están allí.

Cómo puede usted ayudarnos a seguir informando

¿Por qué necesitamos su ayuda para financiar nuestra cobertura informativa en Estados Unidos y en todo el mundo? Porque somos una organización de noticias independiente, libre de la influencia de cualquier gobierno, corporación o partido político. Desde el día que empezamos, hemos enfrentado presiones para silenciarnos, sobre todo del Partido Comunista Chino. Pero no nos doblegaremos. Dependemos de su generosa contribución para seguir ejerciendo un periodismo tradicional. Juntos, podemos seguir difundiendo la verdad.