Meta, la empresa propietaria de Facebook, ha anunciado su decisión de prohibir que las campañas políticas y los anunciantes de sectores regulados utilicen sus nuevos productos publicitarios de IA generativa.

Esta medida, destinada a frenar la propagación de desinformación electoral de cara a las elecciones presidenciales estadounidenses de 2024, se hizo pública mediante actualizaciones en el centro de ayuda de la empresa el lunes por la noche.

Aunque las normas de publicidad de Meta ya prohíben los anuncios con contenido desacreditado, hasta ahora no había reglas específicas relativas al contenido generado por IA.

La compañía aclaró que los anunciantes que realicen campañas relacionadas con vivienda, empleo, crédito, asuntos sociales, elecciones, política, salud, productos farmacéuticos o servicios financieros no podrán utilizar estas funciones generativas de IA.

La nota de Meta decía que la compañía cree que este enfoque le permitirá «entender mejor los riesgos potenciales y construir las salvaguardas adecuadas para el uso de IA Generativa en anuncios relacionados con temas potencialmente sensibles en industrias reguladas».

Meta es la segunda plataforma mundial de anuncios digitales, por detrás de Alphabet, propietaria de Google.

Meta ha presentado tres nuevas herramientas para empresas basadas en IA: generación de fondos, expansión de imágenes y variaciones de texto. La generación de fondos ayuda a crear múltiples fondos para imágenes de productos; la expansión de imágenes ajusta los activos creativos para diferentes plataformas; y las variaciones de texto generan varias versiones de textos publicitarios.

Inicialmente, estas herramientas de IA estaban disponibles para un grupo selecto de anunciantes, pero Meta planea hacerlas accesibles a todos los anunciantes del mundo el año que viene, según un posteo del 4 de octubre.

Estos desarrollos se alinean con la tendencia más amplia de las empresas tecnológicas que se apresuran a lanzar productos publicitarios de IA generativa y asistentes virtuales en respuesta al auge de tecnologías de IA como ChatGPT de OpenAI, que proporciona respuestas escritas similares a las humanas a preguntas y otras indicaciones.

Google ya ha anunciado que está tomando medidas para regular los anuncios basados en IA mediante la restricción de «palabras clave políticas» en sus herramientas de anuncios de IA generativa.

La compañía exigirá que los anuncios que contengan «contenido sintético que represente de forma no auténtica a personas o acontecimientos reales o de aspecto realista» incluyan una nota de divulgación, y esta actualización de la política está prevista para mediados de noviembre.

Nick Clegg, máximo responsable político de Meta, ha subrayado la necesidad de que las empresas tecnológicas se preparen para el posible uso indebido de la IA generativa en las próximas elecciones. Clegg ha pedido que se intensifique el escrutinio de los contenidos relacionados con las elecciones «que pasan de una plataforma a otra» y ha revelado el compromiso de Meta de poner marcas de agua a los contenidos generados por IA.

Meta se comprometió este verano a desarrollar un sistema de «marca de agua» para los contenidos generados por IA. El Sr. Clegg ha dicho anteriormente que Meta está bloqueando su asistente virtual Meta AI de cara al usuario para crear imágenes fotorrealistas de figuras públicas.

TikTok y Snapchat prohíben los anuncios políticos, mientras que X (antes Twitter) aún no ha introducido ninguna herramienta de anuncios generativos de IA.

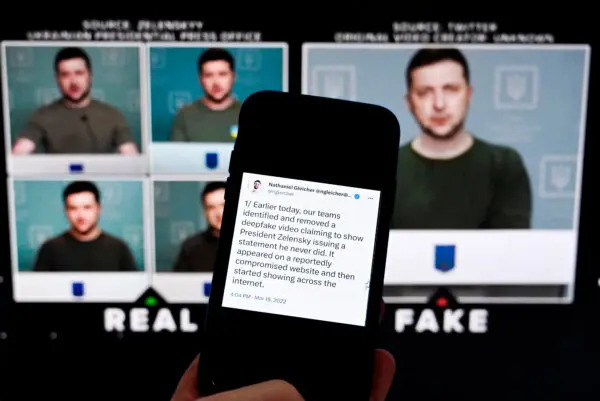

Los legisladores, preocupados por los «deepfakes»

Tras el reciente anuncio de Google de que introduciría requisitos para la divulgación de contenidos generados por IA, varios legisladores estadounidenses están pidiendo a otros gigantes tecnológicos que adopten medidas similares.

La senadora Amy Klobuchar (D-Minn.), presidenta del Comité de Dirección Demócrata del Senado, fue una de las primeras en alabar el anuncio de Meta el martes, sugiriendo que debería ser obligatorio.

«Este es un paso en la dirección correcta, pero no podemos confiar únicamente en compromisos voluntarios», escribió Klobuchar en X. «Estoy trabajando para implementar barreras de seguridad para que los anuncios manipulados por IA no trastornen nuestras elecciones».

La Sra. Klobuchar escribió al fundador de Meta, Mark Zuckerberg, a principios de octubre, preguntando qué salvaguardas se pondrían en marcha para proteger a las figuras políticas de los llamados «deepfakes». Los deepfakes son una forma de tecnología de video que crea imágenes generadas por ordenador que a menudo son indistinguibles de las imágenes reales.

«Con las elecciones de 2024 acercándose rápidamente, la falta de transparencia sobre este tipo de contenido en los anuncios políticos podría conducir a un peligroso diluvio de desinformación relacionada con las elecciones y la desinformación a través de su plataforma, donde los votantes a menudo se dirigen a aprender acerca de los candidatos y temas», escribió la Sra. Klobuchar y la representante Yvette Clarke (D-NY).

Clarke presentó a principios de año un proyecto de ley en la Cámara de Representantes que modificaría una ley electoral federal para exigir etiquetas cuando los anuncios electorales contengan imágenes o videos generados por IA. Klobuchar patrocina un proyecto de ley similar en el Senado.

«Creo que la gente tiene derecho, en virtud de la Primera Enmienda, a colocar en las redes sociales cualquier contenido que les parezca oportuno», declaró Clarke. «Lo único que digo es que hay que asegurarse de poner un descargo de responsabilidad y asegurarse de que el pueblo estadounidense es consciente de que es inventado».

Otro proyecto de ley bipartidista, copatrocinado por el senador Josh Hawley (R-Miss.), iría más allá al prohibir los deepfakes «materialmente engañosos» relacionados con candidatos federales, con excepciones para la parodia y la sátira.

En las elecciones de 2024, los anuncios generados por IA ya están causando sensación. En abril, el Comité Nacional Republicano emitió un anuncio en el que utilizaba IA para pintar una imagen especulativa del futuro bajo la posible reelección del presidente Joe Biden.

El anuncio presentaba imágenes falsas pero convincentes, como escaparates cerrados, patrullas militares y disturbios relacionados con la inmigración.

Únase a nuestro canal de Telegram para recibir las últimas noticias al instante haciendo click aquí

Cómo puede usted ayudarnos a seguir informando

¿Por qué necesitamos su ayuda para financiar nuestra cobertura informativa en Estados Unidos y en todo el mundo? Porque somos una organización de noticias independiente, libre de la influencia de cualquier gobierno, corporación o partido político. Desde el día que empezamos, hemos enfrentado presiones para silenciarnos, sobre todo del Partido Comunista Chino. Pero no nos doblegaremos. Dependemos de su generosa contribución para seguir ejerciendo un periodismo tradicional. Juntos, podemos seguir difundiendo la verdad.