Los jueces de la Corte Suprema debatieron el 21 de febrero durante los alegatos orales hasta qué punto las plataformas de las redes sociales deben ser consideradas responsables cuando grupos terroristas las utilizan para promover su causa.

Miembros conservadores y liberales del alto tribunal expresaron su confusión durante una audiencia que duró 2 horas y 41 minutos, en la que el abogado de la familia de una víctima del terrorismo les instó a recortar las protecciones federales promulgadas hace décadas para impulsar el crecimiento de Internet. A los jueces parecía preocuparles que ir demasiado lejos pudiera socavar esas protecciones federales y abrir la puerta a litigios generalizados sobre los contenidos de Internet.

Las grandes empresas tecnológicas y sus partidarios están muy preocupados por la posibilidad de que el tribunal anule la Sección 230 de la Ley Federal de Decencia en las Comunicaciones de 1996, que impide en general que las plataformas de Internet y los proveedores de servicios de Internet sean considerados responsables de lo que los usuarios digan en ellas. Dicen que la disposición legal ha fomentado un clima online en el que ha florecido la libertad de expresión.

Aunque las plataformas de redes sociales afirman que no deben ser consideradas responsables si los terroristas utilizan sus sitios web, los críticos afirman que el blindaje de las plataformas de redes sociales ha provocado daños en el mundo real. El Congreso lleva años presionando para que se modifique el artículo 230, ya que los conservadores se han quejado de la censura en las redes sociales y los liberales han protestado por la desinformación en Internet.

A excepción del juez Clarence Thomas, que ha sugerido que la Corte Suprema debería revisar el alcance de la Sección 230, las opiniones de los jueces sobre la disposición legal han sido en gran parte desconocidas.

El caso, Gonzalez contra Google LLC, expediente judicial 21-1333, se remonta a 2015, cuando la estudiante Nohemi Gonzalez, de 23 años y ciudadana estadounidense, fue asesinada en un atentado del ISIS en París. El asesinato formaba parte de una serie más amplia de atentados que el grupo terrorista llevó a cabo en esa ciudad y que causaron 129 muertos.

Su familia interpuso una demanda, alegando que Google, propietaria de YouTube, era responsable en virtud de la Ley Federal Antiterrorista por contribuir a los esfuerzos de reclutamiento del ISIS mediante el supuesto uso de algoritmos para dirigir a los usuarios a videos del ISIS.

Los «demandantes afirmaban que Google había permitido a sabiendas que el ISIS publicara en YouTube cientos de videos radicalizadores que incitaban a la violencia y reclutaban a posibles seguidores para unirse a las fuerzas del ISIS que aterrorizaban una amplia zona de Oriente Próximo, y para llevar a cabo atentados terroristas en sus países de origen», según la petición de la familia.

Gracias a las recomendaciones basadas en algoritmos, los usuarios «pudieron localizar otros videos y cuentas relacionados con el ISIS incluso si no conocían el identificador correcto o si la cuenta original de YouTube había sido sustituida».

Los servicios de Google «desempeñaron un papel singularmente esencial en el desarrollo de la imagen del ISIS, su éxito a la hora de reclutar miembros de todo el mundo y su capacidad para llevar a cabo atentados». La demanda original presentada en el caso añadía que «los funcionarios de Google eran plenamente conscientes de que los servicios de la empresa estaban ayudando al ISIS».

Un dividido Tribunal de Apelación de EE. UU. para el 9º Circuito consideró que, en virtud de la Sección 230, las recomendaciones de visualización estaban protegidas por la ley federal, aunque la sección «ampara más actividad de la que el Congreso previó que ampararía». Google negó su responsabilidad en una presentación judicial, alegando que le resulta imposible revisar todos los videos que se publican en YouTube, que acepta más de 500 horas de nuevos contenidos cada minuto.

Durante los alegatos orales del 21 de febrero, el abogado de la familia, Eric Schnapper, sugirió que las recomendaciones de visualización quedan fuera de la protección de la Sección 230.

«Varios de los escritos en este caso instan al tribunal a adoptar una norma general según la cual lo que podría denominarse una recomendación está intrínsecamente protegida por la ley, una decisión que obligaría a los tribunales a elaborar una definición judicial de ‘recomendación'», dijo.

«Creemos que el tribunal debería rechazar esa invitación y, en su lugar, centrarse en interpretar el lenguaje específico del estatuto».

El presidente de la Corte Suprema, John Roberts, se mostró escéptico y le dijo a Schnapper que, a pesar de cualquier algoritmo que YouTube pueda utilizar para empujar a los usuarios a ver videos, la empresa «sigue sin ser responsable del contenido de los videos… o del texto que se transmite».

La jueza Elena Kagan le dijo a Schnapper que tenía razón al decir que el estatuto no distingue entre contenido y recomendaciones de contenido, pero dijo que la ley surgió antes del auge de los algoritmos online.

«Todo el mundo está haciendo lo posible por averiguar cómo se aplica esta ley, cómo se aplica una ley que era anterior a los algoritmos en un mundo posterior a los algoritmos», dijo.

Como Kagan señaló el juez Thomas sugirió anteriormente, en internet «todo implica formas de organizar y priorizar el material», dijo. «¿Su posición nos lleva por el camino de que 230 realmente no puede significar nada en absoluto?».

Schnapper respondió negativamente, diciendo que «los algoritmos son omnipresentes, pero la cuestión es qué hace el demandado con el algoritmo. Si utiliza el algoritmo… para animar a la gente a ver videos del ISIS, eso entra dentro del ámbito de la JASTA».

JASTA se refiere a la Ley federal de Justicia contra los Patrocinadores del Terrorismo de 2016, que permite presentar demandas en tribunales federales contra un Estado extranjero por apoyar el terrorismo internacional, independientemente de si el Estado está oficialmente designado como patrocinador estatal del terrorismo.

Kagan dijo: «Puedo imaginar un mundo en el que tienes razón en que nada de esto recibe protección. Y, ya sabes, cualquier otra industria tiene que internalizar los costes de su conducta. ¿Por qué la industria tecnológica tiene un pase libre? Un poco confuso».

«Por otro lado, quiero decir, somos un tribunal. Realmente no sabemos de estas cosas. No son los nueve mayores expertos de Internet», dijo entre risas, burlándose del tribunal.

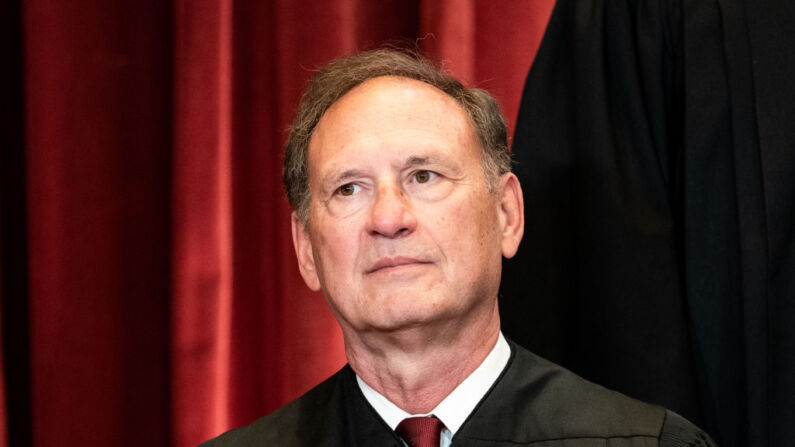

El juez Samuel Alito pareció desconcertado por los comentarios de Schnapper.

«Me temo que estoy completamente confundido por cualquier argumento que esté esgrimiendo en este momento», dijo Alito.

El juez Brett Kavanaugh sugirió que si el tribunal se aparta de las tendencias actuales y falla a favor de la familia, podría dar lugar a muchas más demandas.

«¿No es mejor… mantener las cosas como están?», dijo Kavanaugh al procurador general adjunto Malcolm Stewart. Tal vez el tribunal debería «poner la carga en el Congreso para cambiar eso y que puedan considerar las implicaciones y hacer estos juicios predictivos?».

Stewart dijo que podría haber una ola de demandas, pero pocas «tendrían muchas probabilidades de prevalecer».

Lisa Blatt, abogada de Google, dijo que el Congreso se pronunció claramente al respecto cuando creó la Sección 230, que «prohíbe tratar a los sitios web como ‘el editor o el altavoz de cualquier información proporcionada por otro'».

Así que cuando los demandantes se ven perjudicados por el contenido de un sitio web, la sección «impide la reclamación», dijo Blatt.

La jueza Ketanji Brown Jackson sugirió al abogado que, si bien el artículo 230 protege a las empresas tecnológicas, también las empuja a retirar los contenidos ofensivos.

«¿No es cierto que ese estatuto tenía un alcance más estrecho de inmunidad … que el que los tribunales han interpretado en última instancia y que lo que YouTube está argumentando hoy aquí … [es] realmente … solo para asegurarse de que su plataforma y otras plataformas no se desincentiven para bloquear y filtrar y eliminar contenidos ofensivos?».

El 22 de febrero, la Corte Suprema verá un caso relacionado con la relación entre un atentado terrorista y las redes sociales.

En el caso Twitter Inc. contra Taamneh, expediente judicial 21-1496, se espera que Twitter, Google y Facebook argumenten que no deben ser considerados responsables en virtud de la Ley Antiterrorista de complicidad con el terrorismo internacional por el mero hecho de haber prestado servicios a miles de millones de usuarios entre los que presuntamente se encontraban algunos simpatizantes del ISIS.

Únase a nuestro canal de Telegram para recibir las últimas noticias al instante haciendo click aquí

Cómo puede usted ayudarnos a seguir informando

¿Por qué necesitamos su ayuda para financiar nuestra cobertura informativa en Estados Unidos y en todo el mundo? Porque somos una organización de noticias independiente, libre de la influencia de cualquier gobierno, corporación o partido político. Desde el día que empezamos, hemos enfrentado presiones para silenciarnos, sobre todo del Partido Comunista Chino. Pero no nos doblegaremos. Dependemos de su generosa contribución para seguir ejerciendo un periodismo tradicional. Juntos, podemos seguir difundiendo la verdad.