El único miembro del Congreso con un título avanzado en inteligencia artificial pide cautela mientras otros legisladores y líderes del sector se apresuran a regular esta tecnología.

El representante Jay Obernolte (R-Calif.) es uno de los cuatro programadores informáticos del Congreso y el único con un doctorado en inteligencia artificial. Según Obernolte, lo que más le preocupa de la IA son los usos potencialmente «orwellianos» de la tecnología por parte del Estado.

Recientemente, una coalición de líderes tecnológicos como el propietario de Twitter, Elon Musk, y el director ejecutivo de Apple, Tim Cook, entre otros, pidieron detener totalmente la investigación y el desarrollo de la IA. Esto se produjo tras el lanzamiento de ChatGPT 4, un chatbot de inteligencia artificial extremadamente potente que, entre otros hitos, ha completado pruebas como el examen de abogacía en el percentil 90 y ha aprobado el SAT.

El lanzamiento de ChatGPT 4, sin duda la IA de consumo más potente del mercado, hizo temer que la IA se estuviera volviendo mucho más inteligente mucho más rápido de lo esperado. En su carta, los líderes tecnológicos pedían detener durante seis meses el desarrollo de nueva IA y solicitaban al Congreso que regulara la tecnología.

Obernolte se sentó con The Epoch Times para hablar de la IA y afirmó que la regulación es desacertada y se basa en un malentendido fundamental de la tecnología de la IA.

«No estoy diciendo que no debamos regular», subrayó Obernolte. «Creo que la regulación será necesaria en última instancia».

Pero dijo que los legisladores necesitan asegurarse de que «entienden cuáles son los peligros contra los que estamos tratando de proteger a los consumidores».

«Si no lo entendemos, nos resultará imposible crear un marco regulador que proteja de esos peligros, que es para lo que sirve regular», afirmó Obernolte. «Ahora mismo, está muy claro que no conocemos bien cuáles son los peligros».

Otros miembros del Congreso han pedido que se tomen medidas rápidas al respecto.

«Es algo que nos va a agarrar desprevenidos y llegaremos a un punto en el que estaremos demasiado metidos como para hacer cambios significativos antes de que sea demasiado tarde», declaró el representante Lance Gooden (R-Texas) a Fox News.

Tanto él como otros de ambos partidos han expresado su preocupación por la posibilidad de que la IA se haga cargo de trabajos que antes realizaban los humanos. A otros les preocupa la llamada «Singularidad», un momento previsto en el desarrollo de la IA en el que ésta superará la inteligencia y las capacidades humanas.

No es probable que la IA se apodere del mundo

Obernolte afirma que la carta de los líderes tecnológicos «es útil para llamar la atención sobre la aparición de la IA y el impacto que va a tener en nuestra sociedad». Pero observó que para los no expertos, los mayores temores en torno a la IA son como los que aparecen en las películas de Terminator, una serie sobre la IA que toma el control de las redes informáticas humanas y destruye el mundo en un apocalipsis nuclear.

«El no experto probablemente piense que el mayor peligro de la IA es un ejército de robots malvados que se alzan para apoderarse del mundo», dijo. «Y eso no es lo que quita el sueño a los pensadores de la IA. A mí, desde luego, no me quita el sueño», afirma Obernolte.

Según Obernolte, antes de que el Congreso pueda plantearse siquiera la regulación, tiene que «definir el peligro» en el contexto de la IA. «¿Qué tememos que pueda ocurrir? Necesitamos responder a esa pregunta para responder a la pregunta [de cómo y cuándo regular]».

Uno de los grandes temores citados por Obernolte es el desarrollo de «capacidades emergentes» en la IA. Esto describe una situación en la que una IA es capaz de hacer algo para lo que no estaba programada inicialmente. Pero Obernolte afirma que esto no es tan grave como algunos dicen, ya que sigue tendencias similares a las observadas en los cerebros de los primates.

«Una de las cosas que alarma [a los críticos de la IA] es lo que llaman capacidades emergentes», explicó Obernolte. «La capacidad de un algoritmo de hacer algo para lo que no se le ha entrenado, que ni siquiera se pensaba que sería capaz de hacer y que, de repente, es capaz de hacer.

«Eso asusta y alarma a la gente», continúa. «Pero si se piensa en ello, no debería ser tan alarmante, porque se trata de redes neuronales. Nuestro cerebro es una red neuronal. Y así es como funciona nuestro cerebro. Si nos fijamos, a medida que aumenta el tamaño del cerebro de los primates, de repente empiezan a surgir cosas como el lenguaje… y estamos descubriendo lo mismo sobre la inteligencia artificial. Así que no me parece alarmante».

Obernolte dijo que la función real de ChatGPT 4 no hace sino reforzar su postura.

«Si se examina detenidamente ChatGPT 4, se refuerza la veracidad de lo que digo», afirmó Obernolte. «La IA es un reconocedor de patrones tremendamente potente y eficaz.

«ChatGPT 4 está diseñado para asimilar esta enorme cantidad de lenguaje, imágenes y prosa con el fin de sintetizar respuestas a preguntas», afirmó. «Si piensas en lo que ha alarmado [a los críticos de la IA], en el contexto de todos los datos en los que ha sido entrenada para reconocer patrones, resulta mucho menos alarmante».

La IA no puede pensar ni razonar

Otro aspecto importante de la IA que señaló Obernolte es su incapacidad para superar la prueba de Turing o razonar de forma independiente.

Esto es importante porque si la IA no puede razonar como un ser humano y actuar de forma independiente, supone poco riesgo para los humanos. Casi todos los temores sobre la IA se refieren a que ésta se independice de la humanidad y actúe en contra de sus intereses.

Pero hasta ahora, señala Obernolte, la tecnología ni siquiera puede imitar de forma fiable a un ser humano.

La prueba de Turing, propuesta por el descifrador de códigos británico Alan Turing en la Segunda Guerra Mundial, describe el parecido de una máquina con un ser humano. Para que una IA «pase» la prueba de Turing, los seres humanos que hablen con ella a través de un chat no deben ser capaces de distinguir que están hablando con una IA. La prueba se propuso como medida del perfeccionamiento de la tecnología de IA.

Obernolte opinó que incluso si en el futuro una IA pudiera superar la prueba de Turing, eso no significaría necesariamente que fuera una «entidad pensante y razonadora».

Es una cuestión de debate filosófico si la IA podría llegar a tener motivos o llevar a cabo acciones independientes en el mismo sentido que los seres humanos. Y al menos en el futuro inmediato, según Obernolte, no hay motivos para preocuparse.

«Desde luego, ChatGPT 4 no puede superar la prueba de Turing», afirma Obernolte. «Puede darse el caso de que ChatGPT 6 o 7 pueda pasar la prueba de Turing. Puede que sí. Podríamos estar sentados durante una hora, hablando de un lado a otro, y no ser capaces de determinar si se trata o no de una persona o de un ordenador; eso seguiría sin significar que hayamos creado una entidad pensante y razonadora».

Regular daría poder a los enemigos de EE. UU.

Obernolte afirmó que cerrar la investigación estadounidense en tecnología de IA sólo serviría para dar más poder a los enemigos de Estados Unidos.

«En el caso más draconiano, digamos que mañana introdujera un proyecto de ley que exigiera a todos en los Estados Unidos de América detener el desarrollo de IA que fuera algo más allá de las capacidades de la GPT 4», dijo Obernolte. «Pero seguirían existiendo malos actores en Estados Unidos que verían beneficios económicos en continuar desarrollando IA avanzada y que seguirían haciéndolo y burlando la ley. Seguiríamos teniendo adversarios extranjeros utilizándola».

Por lo tanto, según Obernolte, el desarrollo de la IA seguiría produciéndose, sólo que entre los traficantes del mercado negro y los adversarios de Estados Unidos.

«Es innegable que pondríamos a nuestro país en mayor riesgo de ataque por parte de la IA avanzada si detuviéramos su desarrollo», afirmó. «Porque cuando lo reanudemos, nuestra IA no va a ser tan avanzada como la de los que no se detuvieron. Así que no es realista decir: ‘Que todo el mundo deje de hacer lo que está haciendo'».

«Hablemos de esto», añadió. «Me alegro de que hablemos de ello».

Usos «orwellianos»

Obernolte dijo que no teme que la IA se independice y destruya a la humanidad, pero sí le preocupan los usos «orwellianos» que podría tener la tecnología.

«Me preocupan otros peligros muy reales que, a su manera, tienen las mismas consecuencias y son tan peligrosos como que los robots se apoderen del mundo, pero de formas distintas», afirmó Obernolte.

Por un lado, citó la «asombrosa capacidad de la IA para traspasar la privacidad digital personal».

El resultado, dijo, podría ser ayudar a las entidades gubernamentales o corporativas a predecir y controlar el comportamiento.

Obernolte señaló que la IA podría reunir datos anteriormente disgregados «y utilizarlos para formar modelos de comportamiento que hagan predicciones inquietantemente precisas sobre el comportamiento humano futuro». Y, de paso, dar pistas a la gente sobre cómo influir en ese futuro comportamiento humano».

«Ya se está haciendo», añadió, señalando a las empresas de redes sociales cuyo modelo de negocio entero gira en torno a la recopilación y venta de datos personales.

A nivel corporativo, Obernolte dijo que esto podría significar que unos pocos actores principales formen un «monopolio» sobre los datos con barreras de entrada efectivamente insuperables.

Pero los efectos podrían ser mucho peores si un Estado tomara control de la tecnología, predijo.

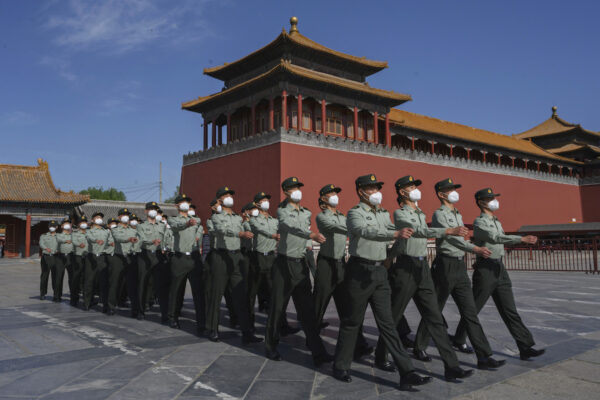

«Me preocupa la forma en que la IA puede facultar a un Estado nación para crear, esencialmente, un Estado de vigilancia, que es lo que China está haciendo con ella», dijo Obernolte. «Han creado el mayor estado de vigilancia del mundo. Utilizan esa información para hacer predicciones sobre la lealtad de la gente al gobierno. Y utilizan esas puntuaciones de lealtad para conceder privilegios. Eso es bastante orwelliano».

«Así que esta es una forma disruptiva que el gobierno puede utilizar», añadió. «Y como hemos aprendido para nuestra desgracia en la historia de nuestro país, tenemos que poner salvaguardas alrededor del gobierno, así como de la industria».

Únase a nuestro canal de Telegram para recibir las últimas noticias al instante haciendo click aquí

Cómo puede usted ayudarnos a seguir informando

¿Por qué necesitamos su ayuda para financiar nuestra cobertura informativa en Estados Unidos y en todo el mundo? Porque somos una organización de noticias independiente, libre de la influencia de cualquier gobierno, corporación o partido político. Desde el día que empezamos, hemos enfrentado presiones para silenciarnos, sobre todo del Partido Comunista Chino. Pero no nos doblegaremos. Dependemos de su generosa contribución para seguir ejerciendo un periodismo tradicional. Juntos, podemos seguir difundiendo la verdad.