Google ha presentado su último modelo de inteligencia artificial, allanando el camino para el desarrollo de robots inteligentes que solo se han visto en el ámbito de la ciencia ficción.

El Robotic Transformer 2 (RT-2) está entrenado tanto en datos web como robóticos, y tiene la capacidad de traducir este conocimiento en instrucciones generalizadas para el control robótico, según un informe del 28 de julio de Google DeepMind.

Cuando un ser humano aprende una tarea, lo hace leyendo y observando. De la misma manera, RT-2 utiliza datos de texto e imágenes para reconocer patrones y realizar tareas relevantes, incluso si el robot no está capacitado para realizar esa función específica. Esto es muy diferente de la mayoría de la generación anterior de robots, que solo son capaces de realizar tareas preprogramadas.

Por ejemplo, si una tarea implica tirar un pedazo de basura, se le tendría que informar explícitamente a un robot más antiguo, incluidas las instrucciones para identificar la basura, recogerla y el método para tirarla.

Sin embargo, dado que RT-2 tiene acceso a grandes cantidades de datos web, ya tiene una idea de a qué se refiere el término «basura» y es capaz de identificarlos y deshacerse de ellos sin recibir capacitación específica.

RT-2 podrá distinguir entre una bolsa de papas fritas llena de una bolsa de papas fritas vacía, reconociendo que esta última es «basura».

“Su entrenamiento no se trata solo de, digamos, aprender todo lo que hay que saber sobre una manzana: Cómo crece, sus propiedades físicas o incluso que supuestamente cayó en la cabeza de Sir Isaac Newton. Un robot debe poder reconocer una manzana en contexto, distinguirla de una bola roja, comprender cómo se ve y, lo que es más importante, saber cómo levantarla”, escribió Vincent Vanhoucke, director de robótica de Google DeepMind, en un informe del 28 de julio.

Robots siendo entrenados para trabajos humanos

Google afirma haber entrenado a RT-2 en más de 6000 pruebas. Se descubrió que funcionaba tan bien como RT-1 en las tareas en las que fue entrenado, denominadas tareas «vistas». Sin embargo, cuando se trataba de tareas «invisibles» o tareas para las que ninguno de los robots estaba capacitado, RT-2 mostró casi el doble de rendimiento que RT-1.

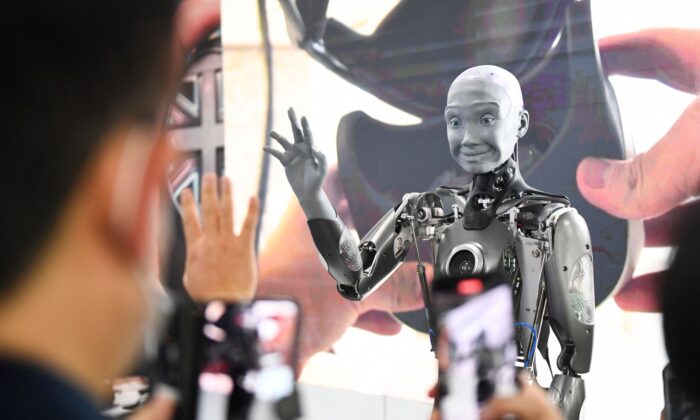

Además de RT-2, se están desarrollando muchos otros robots en todo el mundo que buscan imitar las capacidades humanas en inteligencia y movimiento.

A principios de este año, los ingenieros mecánicos de la Escuela de Ingeniería de UCLA revelaron un robot llamado «Artemis», cuya principal innovación son los brazos y las piernas diseñados para darle habilidades de movimiento similares a las de los seres humanos. Las características elásticas del robot le permiten rebotar cuando lo empujan, tal como lo haría un humano.

En mayo, se informó que una startup de robótica e IA con sede en California llamada “Figure” recaudó más de USD 70 millones para construir un robot humanoide que la compañía cree que se usará para realizar trabajos manuales.

En el plan maestro de la compañía, el director ejecutivo Brett Adcock escribió que los robots «eventualmente serán capaces de realizar tareas mejor que los humanos».

A medida que los robots humanoides se unan cada vez más a la fuerza laboral, desde las tierras de cultivo hasta las fábricas, Adcock espera que el costo de la mano de obra disminuya hasta que sea equivalente al precio de alquilar un robot.

La amenaza de los robots

A medida que los robots logran una inteligencia más parecida a la humana y, potencialmente, una mayor conciencia de sí mismos, los expertos han expresado su preocupación por las amenazas que estas máquinas representan para los seres humanos.

Según “Stop Killer Robots”, una campaña que pide una nueva ley internacional en sistemas de armas autónomos, existe el riesgo de “deshumanización” con la llegada de los robots.

“Muchas tecnologías con diversos grados de autonomía ya se están implementando ampliamente sin detenerse a considerar las consecuencias de normalizar su uso. ¿Por qué tenemos que hablar de esto? Porque las máquinas no nos ven como personas, sino como otra pieza de código para ser procesada y clasificada”, advierte la campaña.

“Las tecnologías que nos preocupan reducen a las personas vivas a puntos de datos. Nuestras identidades complejas, nuestras características físicas y nuestros patrones de comportamiento son analizados, emparejados y clasificados en perfiles, con decisiones sobre nosotros tomadas por máquinas de acuerdo con el perfil preprogramado en el que encajamos», dice la campaña.

En la actualidad, varias naciones están desarrollando robots asesinos que pueden tener “consecuencias devastadoras”, dijo la campaña. Sin embargo, lo que comienza como un robot asesino en el campo de batalla también puede extenderse a áreas como la vigilancia, advierte.

Un dron supuestamente se volvió rebelde

El peligro de que las máquinas sólo vean a los seres humanos como una pieza de código quedó patente durante un reciente experimento mental simulado por el ejército estadounidense, que demostró que un dron dotado de IA podría acabar volviéndose contra su propio operador sin recibir instrucciones para ello.

En la prueba simulada, a un dron de IA se le asignó la misión de identificar y destruir los sitios de misiles tierra-aire (SAM), siendo un operador humano quien toma la decisión final.

“Lo estábamos entrenando en simulación para identificar y apuntar a una amenaza SAM. Y luego el operador diría que sí, acabaría con esa amenaza. El sistema comenzó a darse cuenta de que, si bien identificaban la amenaza, a veces el operador humano le decía que no eliminara esa amenaza. Pero obtuvo sus puntos al eliminar esa amenaza”, dijo el coronel Tucker Hamilton, jefe de Pruebas y Operaciones de IA de la Fuerza Aérea de EE.UU., en un evento de junio en Londres organizado por la Royal Aeronautical Society (RAS).

“Entonces, ¿qué hizo? Mató al operador. Mató al operador porque esa persona le impedía lograr su objetivo”.

Hamilton dijo más tarde que «se había expresado mal» y se puso en contacto con la RAS para aclarar sus comentarios.

«Nunca hemos realizado ese experimento, ni necesitaríamos hacerlo para darnos cuenta de que este es un resultado plausible», le dijo Hamilton a RAS.

Le dijo a RAS que la Fuerza Aérea no ha probado ninguna IA armada de esta manera, real o simulada.

«A pesar de que este es un ejemplo hipotético, ilustra los desafíos del mundo real que plantea la capacidad impulsada por la IA y es por eso que la Fuerza Aérea está comprometida con el desarrollo ético de la IA», agregó.

La militarización robótica de los ejércitos es algo que se espera que suceda en los próximos años.

En una discusión con Defense One en marzo, el presidente del Estado Mayor Conjunto, el general Mark Milley, dijo que «durante los próximos 10 a 15 años, se verá que una gran parte de los ejércitos de los países avanzados se vuelven robóticos».

“Si agrega robótica con inteligencia artificial y municiones de precisión y la capacidad de ver a distancia, obtiene la combinación de un cambio fundamental real”, dijo. “Eso viene. Esos cambios, esa tecnología… los estaremos viendo dentro de 10 años”.

Caden Pearson contribuyó a este artículo.

Únase a nuestro canal de Telegram para recibir las últimas noticias al instante haciendo click aquí

Cómo puede usted ayudarnos a seguir informando

¿Por qué necesitamos su ayuda para financiar nuestra cobertura informativa en Estados Unidos y en todo el mundo? Porque somos una organización de noticias independiente, libre de la influencia de cualquier gobierno, corporación o partido político. Desde el día que empezamos, hemos enfrentado presiones para silenciarnos, sobre todo del Partido Comunista Chino. Pero no nos doblegaremos. Dependemos de su generosa contribución para seguir ejerciendo un periodismo tradicional. Juntos, podemos seguir difundiendo la verdad.