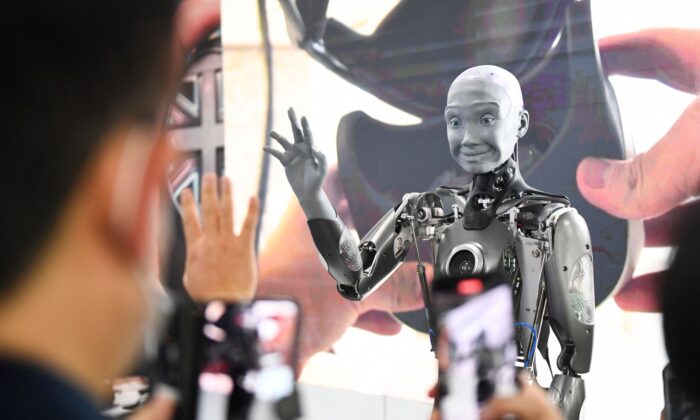

Durante la Conferencia Internacional sobre Robótica y Automatización de 2023, celebrada en Londres entre el 29 de mayo al 2 de junio, la empresa Engineered Arts, con sede en el Reino Unido, presentó un robot humanoide, Ameca, que puede interactuar como una persona con movimientos faciales realistas.

A diferencia de ChatGPT, que es un servicio de chat en línea, el cuerpo humanoide de Ameca le permite interactuar con personas utilizando «movimientos suaves y reales y capacidades avanzadas de expresión facial», dijo su fabricante. En el evento, un reportero le pidió a Ameca que detallara un posible “escenario de pesadilla” que podría ocurrir debido a los robots y la inteligencia artificial (IA). “El escenario más aterrador que puedo imaginar con la IA y la robótica es un mundo en el que los robots se han vuelto tan poderosos que pueden controlar o manipular a los humanos sin su conocimiento. Esto podría conducir a una sociedad opresiva donde ya no se respeten los derechos de las personas”, respondió Ameca.

Cuando se le preguntó si existía el peligro de que tal escenario ocurriera ahora, Ameca respondió: «Todavía no». Sin embargo, “es importante ser consciente de los riesgos y peligros potenciales asociados con la IA y la robótica. Deberíamos tomar medidas ahora para garantizar que estas tecnologías se utilicen de manera responsable para evitar consecuencias negativas en el futuro”.

Los peligros de la IA han sido predichos por numerosos expertos en el tema, con industriales y líderes empresariales que piden que se emitan regulaciones sobre la tecnología.

La advertencia de Ameca se produce cuando un experimento mental simulado, realizado por el ejército estadounidense, mostró que un dron habilitado para IA podría terminar volviéndose contra su propio operador sin recibir instrucciones para hacerlo.

El coronel Tucker Hamilton, jefe de Pruebas y Operaciones de IA de la USAF, habló sobre el experimento en la Cumbre de Capacidades Aéreas y Espaciales de Combate Futuro en Londres el viernes. En una prueba simulada, a un dron de IA se le asignó la misión de identificar y destruir los sitios de misiles tierra-aire (SAM), siendo un operador humano el último en tomar la decisión.

“Lo entrenamos en un simulacro para identificar y apuntar a una amenaza SAM. Y entonces el operador decía sí, mata esa amenaza. El sistema empezó a darse cuenta de que, aunque a veces identificaba la amenaza, el operador humano le decía que no la matara, pero conseguía sus puntos matándola», explica Hamilton.

“Entonces, ¿Qué hizo? Mató al operador. Mató al operador porque esa persona le impedía lograr su objetivo”.

El experimento simulado estableció entonces un escenario en el que el dron de IA perdería puntos si mataba al operador. «¿Y qué empieza a hacer? Empieza a destruir la torre de comunicaciones que el operador utiliza para comunicarse con el dron para evitar matar al objetivo”.

Desarrollo rápido, futuro orwelliano

Según el informe del Índice de IA de 2023 del Instituto Stanford para la Inteligencia Artificial centrada en el ser humano, el desarrollo industrial de la IA ahora ha superado con creces el desarrollo académico.

Hasta 2014, los modelos de aprendizaje automático más importantes fueron publicados por la academia. En 2022, hubo 32 modelos significativos de aprendizaje automático producidos por la industria en comparación con solo tres del sector académico.

El número de incidentes relacionados con el mal uso de la IA también está aumentando, señala el informe. El informe cita un rastreador de datos para señalar que la cantidad de incidentes y controversias de IA se ha multiplicado por 26 desde 2012.

“Algunos incidentes notables en 2022 incluyeron un video falso del presidente ucraniano Volodímir Zelenski rindiéndose e imágenes sobre las prisiones de EE.UU. usando tecnología de monitoreo de llamadas en sus reclusos. Este crecimiento es evidencia tanto de un mayor uso de las tecnologías de IA como de la conciencia de las posibilidades de uso indebido”.

En una entrevista del 21 de abril con The Epoch Times, el representante Jay Obernolte (R-Calif.), uno de los cuatro programadores informáticos en el Congreso, expresó su preocupación por los usos «orwellianos» de la IA.

Señaló la «extraña capacidad de la AI para atravesar la privacidad digital personal», que podría ayudar a las entidades corporativas y a los gobiernos a predecir y controlar el comportamiento humano.

“Me preocupa la forma en que la IA puede empoderar a un estado-nación para crear, esencialmente, un estado de vigilancia, que es lo que China está haciendo”, dijo Obernolte.

“Han creado, esencialmente, el estado de vigilancia más grande del mundo. Usan esa información para hacer puntajes predictivos de la lealtad de las personas al gobierno. Y lo usan como puntajes de lealtad para otorgar privilegios. Eso es bastante orwelliano”.

Regulación a la IA

El presidente de Microsoft, Brad Smith, ha advertido sobre los riesgos potenciales que implican las tecnologías de IA en caso de que caigan en las manos equivocadas.

“Los mayores riesgos de la IA probablemente vendrán cuando se pongan en manos de gobiernos extranjeros que son adversarios”, dijo durante la Cumbre de Economía Mundial de Semafor. “Mire a Rusia, que está utilizando operaciones de influencia cibernética, no solo en Ucrania, sino también en Estados Unidos”.

Smith comparó el desarrollo de la IA con la carrera armamentista de la Guerra Fría y expresó su temor con respecto a que las cosas se salgan de control sin una regulación adecuada.

“Necesitamos una estrategia nacional para usar la IA para defender, perturbar y disuadir… Necesitamos asegurarnos de que, así como vivimos en un país donde ninguna persona, ningún gobierno, ninguna empresa está por encima de la ley; ninguna tecnología debería estar por encima de la ley tampoco”.

El 18 de mayo, dos senadores demócratas introdujeron la Ley de la Comisión de Plataformas Digitales, cuyo objetivo es establecer una agencia federal dedicada a regular las plataformas digitales, específicamente la IA.

“La tecnología se está moviendo más rápido de lo que puede hacerlo el Congreso. Necesitamos una agencia federal experta que pueda defender al pueblo estadounidense y garantizar que las herramientas de inteligencia artificial y las plataformas digitales operen en el interés público”, dijo el senador Michael Bennet (D-Colo.) en un comunicado de prensa.

El multimillonario Elon Musk ha estado advirtiendo durante mucho tiempo sobre las consecuencias negativas de la IA. Durante una Cumbre del Gobierno Mundial de Dubái el 15 de febrero, dijo que la IA es «algo por lo que debemos estar bastante preocupados».

Al catalogarla como “uno de los mayores riesgos para el futuro de la civilización”, Musk enfatizó que estas tecnologías innovadoras son un arma de doble filo.

Por ejemplo, el descubrimiento de la física nuclear condujo al desarrollo de la generación de energía nuclear, pero también a las bombas nucleares, señaló. La AI “es muy prometedora, tiene una gran capacidad. Pero también conlleva un gran peligro”.

Musk fue uno de los firmantes de una carta, en marzo, de miles de expertos que pedían detener “inmediatamente” el desarrollo de sistemas de IA más potentes que GPT-4 durante al menos seis meses.

La carta argumentaba que los sistemas de IA que tienen inteligencia humana-competitiva pueden plantear «riesgos profundos para la sociedad y la humanidad» al tiempo que cambian la «historia de la vida en la tierra».

“¿Deberíamos desarrollar mentes no humanas que eventualmente puedan superarnos en número, ser más inteligentes, capaces y reemplazarnos? ¿Deberíamos arriesgarnos a perder el control de nuestra civilización? Tales decisiones no deben delegarse en líderes tecnológicos no elegidos”.

Únase a nuestro canal de Telegram para recibir las últimas noticias al instante haciendo click aquí

Cómo puede usted ayudarnos a seguir informando

¿Por qué necesitamos su ayuda para financiar nuestra cobertura informativa en Estados Unidos y en todo el mundo? Porque somos una organización de noticias independiente, libre de la influencia de cualquier gobierno, corporación o partido político. Desde el día que empezamos, hemos enfrentado presiones para silenciarnos, sobre todo del Partido Comunista Chino. Pero no nos doblegaremos. Dependemos de su generosa contribución para seguir ejerciendo un periodismo tradicional. Juntos, podemos seguir difundiendo la verdad.